augusti 24, 2025

|13 minuters läsning

In the milliseconds it takes for a webpage to load, a high-stakes decision is made that can define your brand’s reputation. When your meticulously crafted B2B advertisement appears, will it sit proudly beside a credible industry analysis in a trade journal? Or will it materialize next to a sophisticated deepfake video of a CEO spreading market misinformation, just as a key prospect is doing their due diligence on your company? One click, one bad placement, and a multi-million dollar deal could be put in jeopardy before your sales team even knows what happened. This is the central, unavoidable challenge of modern digital advertising. Artificial Intelligence (AI) has given B2B marketers unmatched power for precision targeting and campaign efficiency. However, this double-edged sword also introduces complex new threats to your brand’s safety. Navigating this landscape requires more than just defensive tools—it demands a proactive and intelligent strategy to protect your most valuable asset: din varumärkes integritet. Vad du kommer att lära dig i den här guiden

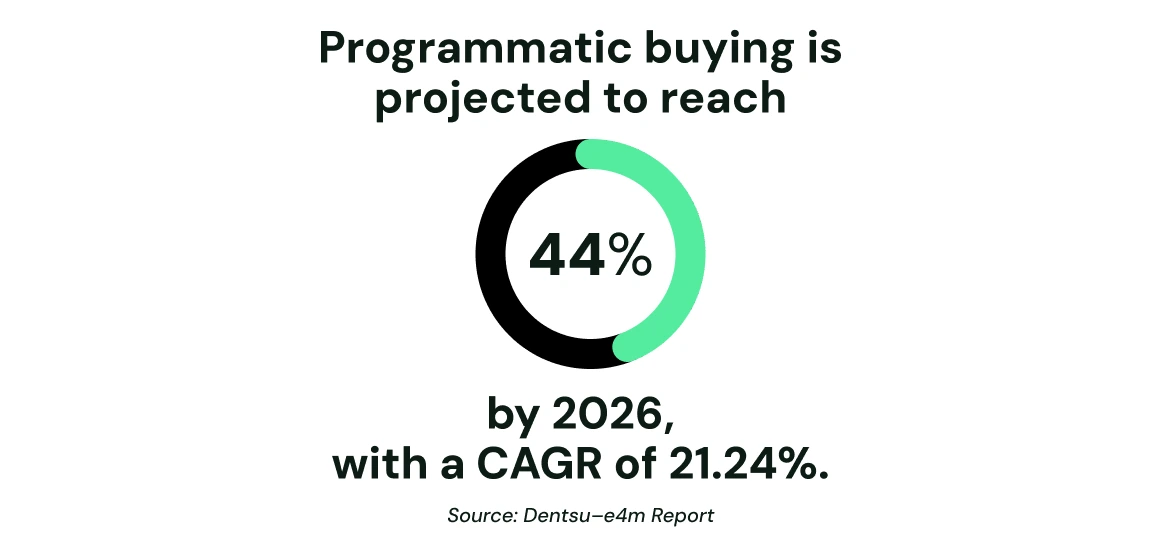

Not long ago, brand safety was a straightforward concept. Marketers relied on whitelists of trusted websites and keyword blocklists to steer clear of universally unsafe categories like violence, adult content, or hate speech. But this approach had its flaws. A brand might block the word “crash” to avoid negative associations, only to miss out on opportunities to appear alongside stories like “krascha marknaden med innovativ teknologi.” It was a blunt instrument: manageable, but inefficient. Then came programmatic advertising. The automation of ad buying across millions of websites brought immense efficiency—but at a cost. Marketers lost visibility and control, as trillions of ad auctions now happen daily in a ”programmatic black box.” Manual oversight became impossible. This shift from direct placements to algorithm-driven delivery created a new, complex brand safety challenge: protecting brand integrity in an unpredictable and opaque digital ecosystem.  According to the Dentsu-e4m report, programmatic buying accounted for 42% of digital ad spend in 2024—a 21% increase over the previous year. This growth is set to continue, with programmatic expected to claim 44% of the market by 2026, growing at a CAGR of 21.24%. With such a significant portion of ad spend now mediated by algorithms, brands are increasingly surrendering control over where their ads appear. In this reality, a reactive approach to brand safety is no longer enough. A strategic, AI-conscious model is essential to maintain brand integrity in a fast-evolving, automated ecosystem.

According to the Dentsu-e4m report, programmatic buying accounted for 42% of digital ad spend in 2024—a 21% increase over the previous year. This growth is set to continue, with programmatic expected to claim 44% of the market by 2026, growing at a CAGR of 21.24%. With such a significant portion of ad spend now mediated by algorithms, brands are increasingly surrendering control over where their ads appear. In this reality, a reactive approach to brand safety is no longer enough. A strategic, AI-conscious model is essential to maintain brand integrity in a fast-evolving, automated ecosystem.

The modern landscape demands a shift from basic brand safety to strategic brand suitability. For B2B, where reputation and trust are paramount to long sales cycles and high-value deals, this is non-negotiable. It’s no longer enough just to avoid inappropriate content; the goal is to find environments that reinforce expertise and credibility proactively. Using advanced AI to analyze context and sentiment, leaders can ensure their brand appears alongside positive industry analysis, not reports of corporate failure. This transforms brand safety from a defensive cost center into a performance driver, maximizing ROI by ensuring marketing investments build trust with high-value accounts.

För globala B2B-varumärken är insatserna högre.“How do we avoid bad content?” but “How do we align with the right content, at the right time, in the right context?” I en trång, skiftande medielandskap är varumärkesskydd inte längre valfritt. Det är en differentiator—och en förutsättning för förtroende.

I B2B, där långa säljcykler, höga värde affärer och djupa förtroenden är av största vikt, kan rykterelaterad skada från en enstaka annonsplacering få allvarliga, långsiktiga ekonomiska konsekvenser. Detta utmaning förstärks av ett komplext digitalt landskap som nu inkluderar sociala medier, Connected TV (CTV) och Digital Out-of-Home (DOOH), med AI som motor för att skapa nya och subtila hot. För marknadsföringsledare förstärks risken av moderna utmaningar som desinformation, den skalbara skapelsen av syntetiskt innehåll via generativ AI, och snabbt skiftande kulturella normer. Dessa hot är särskilt svåra att hantera över fragmenterade team, flera byråer och snabbt föränderliga miljöer. Däremot är kärnproblemet ofta internt: brist på tydligt, dokumenterat ansvar för vem som äger risker kopplade till varumärkesskydd och definierar acceptabla toleransnivåer. Teknologi och AI-filter kan inte ensamma lösa detta styrningsgap. Därför rekommenderas en strategi som övergår från en rigid, enbart teknologisk metod till en dynamisk modell som blandar avancerade verktyg med sakkunnig mänsklig bedömning för att navigera nyanser och kontext.

AI-verktyg är kraftfulla, men de saknar ofta riktig mänsklig kontextförståelse. De matchar nyckelord, inte avsikt. Detta leder till skarpa placeringar som kan skada ditt rykte. Föreställ dig en deepfake-video av en respekterad branskanalytiker som gör falska negativa påståenden om din marknad, medan din företags annons för en relaterad lösning visas direkt bredvid. Denna oavsiktliga koppling är omedelbart skadlig och kan fångas på skärmen och delas av konkurrenter. Denna risk sträcker sig bortom video och inkluderar AI-genererade ”expertexter” eller bloggar som främjar felaktiga data eller falska finansiella rapporter utformade för att manipulera marknadens uppfattning. Hotet är så betydande att FN har uppmanat till starkare globala åtgärder mot djupfalskt innehåll innan det urholkar allmänhetens och företags förtroende (Reuters).

AI-algoritmer är kraftfulla, men de saknar ofta riktig mänsklig kontextförståelse. De matchar nyckelord, inte avsikt. Detta leder till störande placeringar som kan skada ditt varumärke. Överväg en annons för din molnsäkerhetsprogramvara som visas bredvid en stor nyhetsartikel om en katastrofal företagsdataöverträdelse. Även om nyckelorden matchar, gör kontexten att ditt varumärke framstår som tonlös, inkompetent eller till och med rovlysten, vilket undergräver din lösnings trovärdighet i ett kritiskt ögonblick.

Modern brand safety platforms now offer a multi-layered defense system that operates at the speed of programmatic advertising, vetting ad placements in real time.

Modern brand safety platforms now offer a multi-layered defense system that operates at the speed of programmatic advertising, vetting ad placements in real time.

This goes far beyond simple keywords. UsingNatural Language Processing (NLP), the AI acts like a speed-reader with perfect comprehension. It analyzes the text on a page to understand not just the topic, but also the sentiment (positive, negative, neutral), the tone (e.g., clinical, satirical, angry), and the nuance of the language. Simultaneously,computer vision technology scans images and video frames for unsafe or inappropriate visuals. Together, these tools can tell the difference between a serious news report on a corporate crisis and a satirical article in a business magazine, ensuring your ads are placed in genuinely suitable environments (Supermetrics).

The most effective AI tools work proactively in milliseconds before the ad is even bought. This is known as pre-bid analysis. Before your ad platform places a bid on an available ad slot, the safety AI analyzes the page content, scores it against your brand’s specific safety and suitability rules, and blocks the bid entirely if the environment poses a risk. This prevents your ad from ever appearing in the wrong place.

Beyond content, AI is crucial for sniffing out ad fraud. It is trained to recognize the difference between human and non-human behavior. It can identify patterns indicative of botnets, click fraud (bots generating fake clicks), impression fraud (fake views), and domain spoofing (when a low-quality site masquerades as a premium one). This ensures your budget reaches real business audiences, not criminal operations.

Despite its power, treating AI as a ”set it and forget it” solution is a recipe for failure. The technology has blind spots and inherent limitations that demand strategic management.

Given AI’s limitations, human oversight isn’t a legacy function—it’s an essential strategic component. The smartest brands build a brand safety ”Center of Excellence” where human experts guide the technology. This ”human-in-the-loop” approach is critical for success. This team typically includes an Ad Ops specialist, a data analyst, a brand strategist, and a policy expert. These human strategists provide the contextual judgment, ethical reasoning, and industry expertise that AI lacks. Their job isn’t to review every placement, but to manage the system. A strong human review process involves:

Den högsta nivån av varumärkesskydd går bortom att bara undvika olämpligt innehåll till att aktivt söka den perfekta miljön. Detta är den avgörande utvecklingen från brand safety till brand suitability>/strong>. Denna skräddarsydda metod anpassar annonsplaceringar till dina specifika värderingar och budskap. För ett cybersäkerhetsföretag kan en neutral artikel om dataskydd vara ”säker”, men en djupgående analys av framväxande företags säkerhetshot är ”lämplig”—och mycket mer värdefull när du når rätt kunds tänkande (Seekr). Utvecklingen av en lämplighetsram är en strategisk övning som involverar tre nyckelfaser:

Landskapet utvecklas ständigt, drivet av tre nyckelkrafter:

Artificiell intelligens erbjuder enorma möjligheter för B2B-marknadsförare och möjliggör en precision och skala som tidigare var otänkbar. Men det skapar också djupa risker för valutan som betyder mest inom affärer: förtroende och rykte. Framgång ligger inte i att välja mellan innovation och ansvar, utan i att skickligt balansera dem. Framtiden tillhör dem som lär sig leda teknologin, inte bara följa den. Genom att kombinera kraften hos sofistikerade AI-verktyg med visdom från mänsklig tillsyn—and genom att höja målet från bara säkerhet till holistisk varumärkesscheman—kan du navigera denna nya frontier med självförtroende. Denna strategi kommer inte bara att skydda ditt varumärkes hårt vunnna rykte utan också bygga en mer motståndskraftig, autentisk och lönsam relation med dina kunder.

Please enter your email address so we can send you a one-time pass code and verify if you are an existing subscriber.